2025年了,跑大模型尤其是70B级别的LLM(Llama3.1-70B、Qwen2-72B等),硬件选择直接决定你的钱包和效率!今天我们来硬核对比三张热门卡:消费级王者RTX 4090、专业工作站老将A6000、数据中心霸主H100。

重点场景:70B模型的推理(vLLM/TensorRT-LLM)和QLoRA微调。数据来自BIZON、LocalLLaMA社区、HuggingFace实测和2025最新基准(单卡对比为主)。

核心规格对比

| 项目 | RTX 4090 | RTX A6000 | H100 (PCIe/SXM) |

|---|---|---|---|

| 架构 | Ada Lovelace | Ampere | Hopper |

| VRAM | 24GB GDDR6X | 48GB GDDR6 | 80GB HBM3 |

| TDP功耗 | 450W | 300W | 350-700W |

| 内存带宽 | 1TB/s | 768GB/s | 3TB/s+ |

| 当前价格(2025.12) | 新卡≈$2500-2800 二手≈$2000-2200 | ≈$4000-5000(二手更便宜) | $25,000-35,000 |

| 适用场景 | 个人/小型团队推理+微调 | 专业工作站、大模型加载 | 企业级训练/高吞吐推理 |

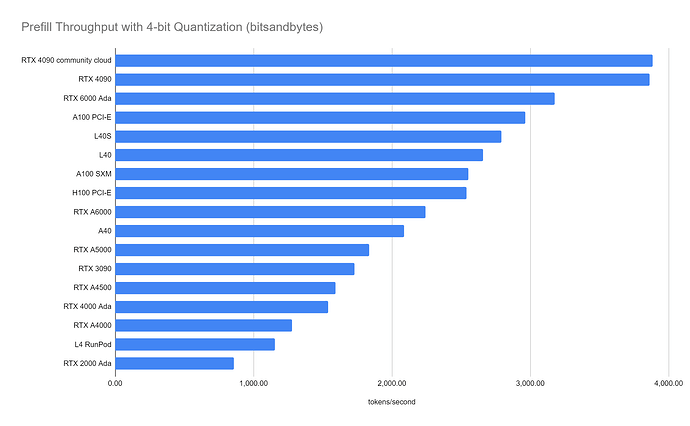

70B模型推理速度实测(vLLM/TensorRT-LLM,4bit量化,tokens/s)

- RTX 4090:单卡≈40-60 t/s(Unsloth+flash-attn优化可达更高),家用王者!

- A6000:单卡≈30-45 t/s(48GB能更稳加载70B,但架构老,速度不如4090)

- H100:单卡≈100-150 t/s(Transformer Engine+高带宽碾压),企业级吞吐无敌

结论:推理单卡性价比,4090完胜!H100适合高并发服务。

QLoRA微调70B模型速度(Axolotl/Unsloth,单卡实测)

- RTX 4090:单卡可训(<22GB显存占用),速度≈2-3样本/秒(全流程几天地完成小数据集)

- A6000:更稳(48GB裕量大),但速度慢20-30%(老架构)

- H100:单卡飞起(更高效率),但贵到哭

多卡扩展:2x4090 ≈1x H100性能,但成本仅1/10!

功耗&成本PK

-

功耗:A6000最省电(300W),4090中规中矩,H100电老虎(满载700W+,需专业散热)

-

性价比:RTX 4090遥遥领先!$2500买到接近专业卡性能,家用/小型社区首选。H100适合大厂烧钱训练,A6000过渡卡(二手值得考虑)

如果你是个人开发者、AI爱好者、开源社区玩家——RTX 4090仍是绝对性价比之王!单卡跑70B推理丝滑,QLoRA微调无压力。H100是企业烧钱玩具,A6000适合需要大显存的专业老鸟。

你们用什么卡跑70B?单4090够用吗?欢迎分享实测数据和配置!![]()

![]()