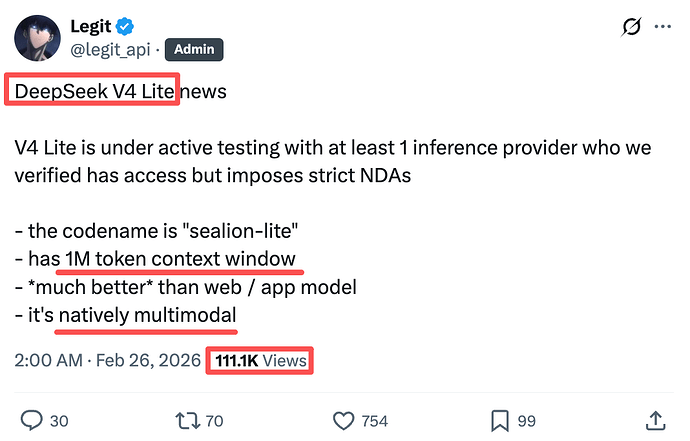

2026 年 2 月下旬,AI 圈被 DeepSeek 未发布的新模型引爆 —— 代号 “sealion-lite” 的 DeepSeek V4 Lite 通过多方爆料浮出水面。这款模型以 100 万 token 上下文窗口、原生多模态能力和大幅优化的生成质量,成为行业焦点。更引人关注的是,路透社证实 DeepSeek 已向华为等国内芯片厂商开放提前测试权限,而英伟达、AMD 等美国厂商暂未获得访问权,引发市场对硬件适配格局的热议。

核心亮点:1M 上下文 + 原生多模态,性能碾压前代

根据开发者爆料与流出的实测示例,DeepSeek V4 Lite 的核心升级集中在 “长上下文、强多模态、高质量生成” 三大维度,即便 “非思考模式” 也远超 V3.2 的 “思考模式”。

1. 上下文窗口扩容至 1M,覆盖超长场景

V4 Lite 将上下文长度提升至 100 万 token,相比 V3.2 最初的 128K 扩容近 8 倍,且无需依赖特殊优化即可稳定运行。这一升级使其能轻松处理超长文档分析、多轮对话记忆、大规模代码调试等场景 —— 例如一次性解析整本书籍、处理百万字级别的项目文档,或支持数千轮连续对话而不丢失上下文。

值得注意的是,2 月 11 日 DeepSeek V3.2 已灰度升级至 1M 上下文,知识库更新至 2025 年 5 月,这被业界解读为 V4 系列的 “预热动作”,验证了长上下文技术的成熟度。

2. 原生多模态,SVG 生成质量惊艳

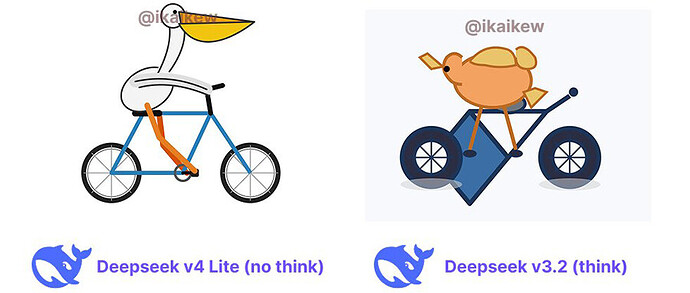

作为 DeepSeek 首款原生支持多模态的轻量模型,V4 Lite 的跨模态生成能力通过流出的 SVG 示例得到验证:

-

具象场景生成:在 “骑自行车的鹈鹕” 任务中,V4 Lite 生成的图像贴合常识,鹈鹕与自行车的形态逼真,互动逻辑合理;而 V3.2 生成的形象模糊,动作表达失真;

-

复杂物体还原:生成 “Xbox 360 手柄” 时,V4 Lite 精准还原多个按键、转轴等细节,符合硬件功能设定,V3.2 则简化严重,缺乏核心特征;

-

代码优化:生成的 SVG 文件本地化代码更少,质量更高,展现出高效的生成逻辑。

此外,多方消息显示,V4 Lite 还支持图文联合分析,可处理报表解析、截图调试等实用场景,多模态能力将随正式版进一步完善。

3. “轻量” 非弱能,聚焦成本优化

网友对 “Lite” 的解读形成共识:并非功能阉割,而是成本优化。爆料称 V4 Lite 可能采用小参数架构(有猜测为 2850 亿参数),通过工程化优化实现 “超长上下文 + 多模态” 的轻量运行,推理成本远低于同类大模型。这种 “低成本 + 强功能” 的组合,被认为可能改变行业格局 —— 让超长上下文推理从 “高成本特权” 变为 “大众化服务”。

硬件适配风波:华为抢先测试,英伟达暂被排除

DeepSeek 的硬件适配策略引发行业广泛关注。根据路透社独家报道,DeepSeek 已将 V4 系列模型向华为等国内供应商开放提前访问权,用于优化处理器软件,确保模型在国产硬件上高效运行;而英伟达、AMD 等美国芯片厂商暂未获得测试权限。

这一策略被解读为两重考量:

-

国产硬件生态协同:华为昇腾等芯片正加速 AI 生态布局,DeepSeek 通过提前适配,可抢占国产硬件场景的先发优势,契合国内 AI 产业自主化趋势;

-

技术安全与市场平衡:在中美 AI 硬件竞争背景下,优先保障国内厂商的适配进度,同时避免核心技术过早向海外硬件厂商泄露。

市场反应显示,投资者对这一策略持积极态度 —— 有网友提及,DeepSeek V3 系列曾让英伟达市值单日蒸发 6000 亿美元,而 V4 Lite 的硬件适配倾斜,可能进一步影响全球 AI 芯片市场格局。

发布预期:3 月初或亮相,用户呼声高涨

结合多方爆料与行业预测,DeepSeek V4 系列的发布时间逐渐清晰:

-

测试进度:V4 Lite 已进入积极测试阶段,至少一家推理提供商签署保密协议获得访问权,SVG 等多模态生成功能已初步验证;

-

发布窗口:综合媒体预测,正式版本预计在 2026 年 3 月初至 3 月中旬推出,恰好覆盖部分用户的竞品订阅到期节点(如 3 月 4 日到期的 Claude 订阅);

-

版本规划:将推出两个版本 ——V4 Lite(响应速度快、成本优化)与 V4 标准版(编码能力更强、耗时较长),满足不同场景需求。

用户对 V4 Lite 的期待集中在 “长上下文实用性” 与 “多模态落地”:不少开发者表示,1M 上下文 + 低推理成本的组合,将解决超长文档处理、大规模代码开发等痛点;而原生多模态能力则能简化工作流,无需切换多个工具即可完成 “文本→图像→代码” 的跨模态任务。

行业影响:重新定义轻量模型的价值边界

DeepSeek V4 Lite 的曝光,打破了 “轻量模型 = 功能简化” 的行业认知,其核心启示在于:

-

工程化优化的价值:通过上下文压缩、多模态融合等工程技术,小参数模型也能承载核心复杂功能,大幅降低推理成本,推动 AI 规模化应用;

-

硬件 - 软件协同的重要性:优先适配国产硬件,不仅能拓宽市场渠道,更能在自主化趋势下构建差异化优势;

-

长上下文 + 多模态成标配:1M 上下文与原生多模态的组合,将成为下一代大模型的基础配置,倒逼行业加速相关技术落地。

截至目前,DeepSeek 官方尚未对 V4 Lite 的爆料进行回应,但市场已进入 “倒计时期待”。若其正式发布后能兑现爆料中的性能承诺,或将引发新一轮 AI 模型竞争,尤其是在成本敏感型场景与国产硬件生态中,有望占据先发优势。