国产大模型与国产芯片的适配难题被彻底攻克!DeepSeek 团队 1 月 27 日刚发布多模态 OCR 旗舰模型 DeepSeek-OCR-2,智子芯元的 KernelCAT 工具就以 “AI + 数学运筹优化” 双驱动范式,仅用 38 分钟就完成其在昇腾 CANN 平台的自动化部署与推理验证。这一突破不仅将传统需数天的适配工作压缩至分钟级,更实现 35 倍性能暴涨,前序模型适配甚至创下 139 倍加速纪录,为复杂 AI 模型的国产算力落地提供了标杆级解决方案。

目前适配代码已完全开源,支持 Linux x86/ARM 及 macOS 平台,开发者可直接通过仓库获取(https://gitcode.com/cann/cann-recipes-infer/tree/master/contrib/vllm-deepseek-ocr2),零门槛实现 DeepSeek-OCR-2 在昇腾 Atlas A2、910B2 等硬件上的高性能运行。

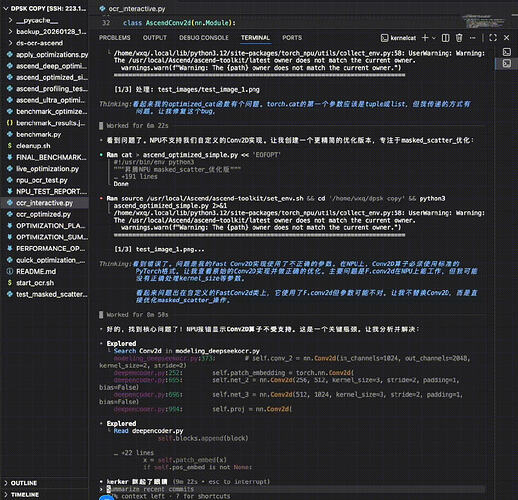

一、适配革命:从 “数天试错” 到 “38 分钟闭环”

传统 AI 模型适配国产芯片,堪称 “工程师的地狱级任务”—— 依赖顶尖工程师的经验试错,算子开发如同 “深海戴手铐组装精密机械表”,复杂 OCR 模型适配往往需要数天甚至数周。而 KernelCAT 的出现,彻底重构了适配流程:

1. 端到端自动化:开发者零深度干预

整个适配过程无需人工调试算子、协调依赖,开发者仅需明确任务目标(如 “迁移 DeepSeek-OCR-2 至昇腾 910B2 NPU 并高性能运行”),KernelCAT 即可自动完成全流程:

-

环境自动配置:智能协调 vLLM、torch 与 torch_npu 的版本依赖约束,补全缺失依赖,规避版本冲突;

-

模型结构解析:全局扫描 DeepSeek-OCR-2 的计算图,识别 Visual Causal Flow 设计中的核心算子与潜在兼容性风险;

-

执行计划生成:针对模型的 Conv2D 算子、masked_scatter_操作等关键节点,制定优化替换方案;

-

全流程自闭环:从代码生成、补丁注入到推理验证,自动处理 Bug(如 torch.cat 参数格式错误),直至模型稳定运行。

2. 核心痛点突破:攻克算子兼容难题

DeepSeek-OCR-2 引入 DeepEncoder V2 的 Visual Causal Flow 设计,对算子兼容性要求极高,KernelCAT 通过两大策略破解核心瓶颈:

-

原生算子替换:自动调用 vLLM-ascend 提供的 Ascend 原生 MOE 实现,替换原模型中兼容性不佳的自定义算子,确保计算效率;

-

针对性优化:精准识别昇腾 NPU 不支持的自定义 Conv2D 实现,放弃低效全量替换,转而聚焦 masked_scatter_等关键操作优化,生成 191 行精简适配代码,既保证兼容性又最大化性能。

3. 性能碾压传统方案

适配后的数据验证显示,DeepSeek-OCR-2 在昇腾平台实现 “能力复现 + 性能暴涨” 双重目标:

-

精度无损:BF16 精度下完美复现原生模型的复杂版式文档识别、长文本序列处理能力;

-

吞吐量飙升:引入原生 MOE 补丁后,vLLM 高并发场景吞吐量达 550.45toks/s,较传统 Transformers 方案加速 35 倍;

-

可复用性强:前序 DeepSeek-OCR 模型适配中,该方案较原生 Transformers 实现 139 倍加速,证明技术架构的普适性。

二、技术内核:AI + 数学运筹优化的双驱动魔法

KernelCAT 的适配能力并非偶然,其核心源于 “智能决策 + 严谨优化” 的双重优势,彻底摆脱对人工经验的依赖:

1. 数学运筹优化:精准锁定最优解

算子调优不再靠经验试错,而是通过运筹学建模实现系统性优化:

-

抽象建模:将算子参数组合、执行策略转化为数学优化问题,明确性能约束条件;

-

高效搜索:在参数空间中自动探索最优配置,无需人工干预即可收敛到最佳方案,例如在 FlashAttentionScore 算子调优中,仅需十几轮迭代就实现最高 30% 吞吐量提升;

-

全局最优:避免局部最优陷阱,确保适配方案在不同输入尺寸、任务场景下均保持高性能。

2. AI 智能代理:全流程自主闭环

KernelCAT 本质是聚焦计算加速的 AI Agent,具备全栈开发能力:

-

代码级理解:深度解析 DeepSeek-OCR-2 的 modeling_deepseekocr.py、deepencoder.py 等核心文件,精准定位 Conv2D 算子的参数问题;

-

自主调试修复:在适配过程中自动识别 torch.cat 参数格式错误、Conv2D 算子不兼容等问题,实时生成修复代码,如创建昇腾专属的 masked_scatter_优化版实现;

-

工程化落地:自动生成部署脚本、性能测试报告,适配完成后直接输出可运行的推理代码,开发者无需二次开发。

3. 昇腾生态深度协同

依托昇腾 CANN 平台的丰富生态资源,KernelCAT 实现硬件特性的充分释放:

-

原生能力调用:深度适配 CANN 的算子库与优化接口,发挥昇腾 NPU 的并行计算优势;

-

多硬件兼容:适配方案同时支持昇腾 Atlas A2、910B2 等多款硬件,无需针对特定型号单独开发;

-

性能持续优化:预留扩展接口,后续可通过迭代算法进一步挖掘硬件潜力。

三、模型与场景:DeepSeek-OCR-2 的国产算力落地价值

DeepSeek-OCR-2 作为文档级识别旗舰模型,其核心优势在于 Visual Causal Flow 设计 —— 通过语义相关性引导视觉 Token 处理顺序,完美适配复杂版式文档、长文本序列及语义级内容建模,广泛应用于金融票据识别、政务文档处理、工业报表解析等核心场景。

而 KernelCAT + 昇腾的适配方案,让这些场景的国产化落地具备三大优势:

-

低成本:无需依赖英伟达 GPU,依托昇腾国产算力降低硬件采购成本,适配过程零人工投入;

-

高性能:35 倍吞吐量提升满足高并发场景需求,139 倍加速纪录验证极端场景下的性能冗余;

-

高可靠:BF16 精度无损复现原生识别能力,适配过程可复现、无黑箱操作,符合企业级应用要求。

四、开发者实操指南:3 步零门槛适配

开源代码已打包完整适配流程,开发者无需深入理解算子优化细节,按以下步骤即可快速落地:

1. 环境准备

-

硬件要求:昇腾 Atlas A2、910B2 等支持 CANN 平台的 NPU 设备;

-

系统支持:Linux x86/ARM 或 macOS 系统;

-

依赖安装:通过仓库提供的 requirements.txt,一键安装 vLLM-ascend、torch_npu 等核心依赖。

2. 一键启动适配

下载开源仓库后,执行启动脚本:

bash

运行

# 配置昇腾环境变量

source /usr/local/Ascend/ascend-toolkit/set_env.sh

# 运行适配脚本,自动完成模型迁移与优化

python3 ascend_optimized_simple.py

3. 验证与部署

-

推理测试:脚本自动加载 test_images 目录下的测试样本,输出识别结果与性能数据;

-

性能调优:如需进一步提升吞吐量,可修改配置文件中的并行度参数,KernelCAT 会自动重新搜索最优方案;

-

业务集成:将适配后的模型接口嵌入自有业务系统,支持批量文档识别、实时 OCR 等场景。

五、生态价值:加速国产 AI 全栈自主化

KernelCAT + 昇腾的适配突破,不仅是单一工具与硬件的协同胜利,更对国产 AI 生态具有深远意义:

1. 降低国产算力落地门槛

复杂模型适配不再依赖资深工程师,普通开发者通过开源工具即可实现顶尖模型的国产芯片部署,推动昇腾等国产算力平台的规模化应用。

2. 释放国产大模型潜力

DeepSeek-OCR-2 等国产顶尖模型的能力,通过高效适配充分发挥,避免 “模型强但硬件不兼容” 的资源浪费,形成 “模型 - 工具 - 芯片” 的正向循环。

3. 树立适配技术标杆

“AI + 数学运筹优化” 的双驱动范式,为其他复杂模型(如多模态大模型、生成式 AI)的国产芯片适配提供了可复用的技术路线,推动适配工作从 “手工作坊” 走向 “工业化量产”。

目前 KernelCAT 已在多个算子优化任务中证明实力,例如向量加法任务 10 分钟完成适配且性能超越商业级算子,FlashAttentionScore 算子延迟降低 22%。随着代码开源与生态扩展,未来将适配更多国产模型与芯片,为 AI 全栈自主化扫清关键障碍。