最近,业界传闻DeepSeek将在春节前发布新一代模型。昨日在飞机上,我仔细复盘了DeepSeek这些年的研究路线,决定结合其技术脉络做一个系统性的猜测。本文分为两大部分:第一部分回顾DeepSeek的整体研发路径,从稀疏化(Sparsity)作为Scaling的核心逻辑入手;第二部分基于现有线索,对即将到来的DeepSeek-V4进行推测。很多人可能已经猜到Attention结构会结合DSA + mHC + Engram,但我更想深入探讨这些设计的理论基础与工程Know-How。

1. 稀疏化是贯穿始终的主旋律

从DeepSeek诞生至今,其模型结构演进展现出一条极为清晰的脉络:对不同模块进行针对性的稀疏处理。背后的核心驱动力其实非常朴素——现代训练与推理体系面临严峻的“内存墙”(Memory Wall)问题。计算资源相对容易通过并行扩展,而内存带宽与容量则难以同等速度Scaling。因此,DeepSeek始终围绕“减少访存、提升计算效率”这一目标持续优化。我们先来系统回顾这条脉络。

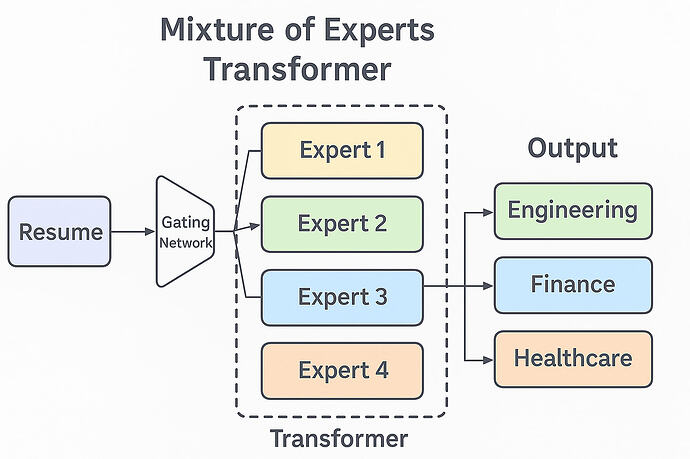

1.1 MoE:FFN层的Fine-Grained稀疏化

DeepSeek从MoE入手,对FFN层进行细粒度专家划分,演进历程清晰可循(可参考《详细谈谈DeepSeek MoE相关的技术发展》):

- DeepSeek-V1:首次引入Fine-Grained Expert,并设置独立Shared Expert。通过辅助损失函数同时实现专家负载均衡与设备负载均衡。配置为64个路由专家 + 2个共享专家,Top-k=6。

- DeepSeek-V2:路由专家增至160个,共享专家仍为2个,Top-k保持6。新增Device-Limit Routing、通信负载均衡辅助损失,并引入Token丢弃策略,进一步优化训练稳定性与推理效率。

- DeepSeek-V3:路由专家扩展至256个,共享专家减至1个,Top-k提升至8。引入专家分组机制,彻底摆脱传统辅助损失函数,实现无需辅助损失的负载均衡。同时取消Device-Limit Routing与Token丢弃,开发DeepEP新型通信范式,配合Redundancy Expert与EPLB完成更精细的负载均衡。

至此,FFN层的MoE稀疏化路径基本成熟,形成了高度工程化的解决方案。

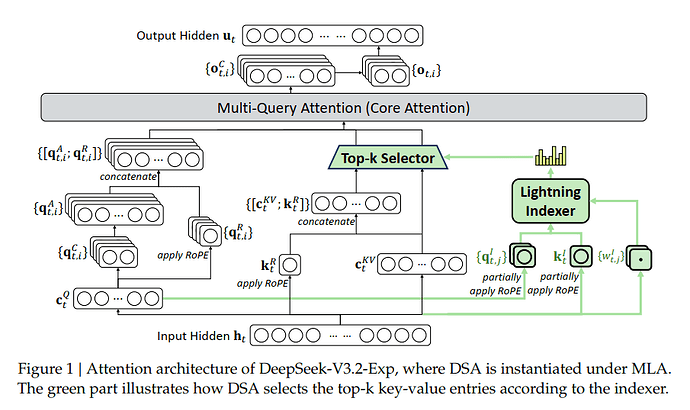

1.2 Attention:从MLA到NSA再到DSA的稀疏化探索

当FFN稀疏化趋于稳定后,Attention自然成为下一个优化目标。Attention计算复杂度为O(n²),随着现代大模型对超长上下文的需求不断提升,构造Sparse Attention既能降低计算开销,又能缓解Softmax归一化导致的概率“稀释”问题(即使某个选项logit很高,归一化后分布仍趋于平坦)。

早期,DeepSeek通过MLA(Multi-head Latent Attention)压缩KV缓存,显著降低访存带宽(详见《从MHA到MLA看Attention优化:谈谈DeepSeek拼多多级的推理价格》)。随后推出的Native Sparse Attention(NSA)更进一步,其设计理念非常直观:

- Compression:尽可能捕获全局输入的摘要信息;

- Sliding Window:保留最近上下文的局部注意力焦点;

- Top-n Selection:通过选择机制弥补压缩阶段丢失的细粒度重要信息。

NSA论文中对此前各类Sparse Attention方案(Hash、随机、Pooling等)进行了点评,指出它们要么包含不可训练组件,要么反向传播效率低下。DeepSeek的方案则保持了全可训练与高效BP的特性。

随后,DeepSeek-V3.2引入DSA(DeepSeek Sparse Attention),对NSA做了大幅简化:从block-wise selection改为token-wise selection,使用小型indexer选出top-2048个关键token。先在Full MLA基础上通过继续预训练预热Indexer,再利用KL散度约束使其输出分布尽可能贴近完整Attention。这种“自KL对齐”思路实际上是工业界处理Sparse Attention的常见范式(去年愚人节我曾开玩笑提出过类似思路)。

值得一提的是,业界在此存在分歧:Qwen、Kimi等团队选择了Linear Attention路径(详见《谈谈未来Attention算法的选择:Full、Sparse还是Linear?》)。

2. 对DeepSeek-V4模型架构的推测

近期mHC与Engram论文已透露出明显信号。即使我们暂时“假装”没读过这些论文,也能从Scaling逻辑推导出大致方向。继续堆叠MoE专家数量?理论上可行,但在Engram出现前,许多观点确实倾向于此。然而专家过多会导致更多dead expert、通信压力剧增,收益递减。因此MoE的进一步Scaling难度较大,注意力自然转向Attention层。

DeepSeek似乎采取了一种“tick-tock”式迭代策略:V1主打MoE,V2引入MLA优化Attention,V3回归MoE深度改进,V4则极有可能再次聚焦Attention革新。我预计新Attention结构将基于DSA + mHC + Engram组合构建。

Sparse Attention已较好解决O(n²)计算复杂度中n²项的瓶颈,但一个更自然的扩展思路是:在不显著增加计算复杂度的前提下,进一步提升模型表达能力。例如扩大隐含维度,或引入旁路高维稀疏处理后再降维,而不直接扩展Attention自身维度。这种思路早在2024年DeepMind的TransNAR论文中就有所体现,也引发了我关于SAE-GNN可组合Transformer的猜想。

最终方向指向跨层旁路稀疏运算,甚至可Offload至CPU,实现多层信息注入。这正是mHC与Engram的结合。从微观视角,N-gram本身也可视为一种稀疏图结构。

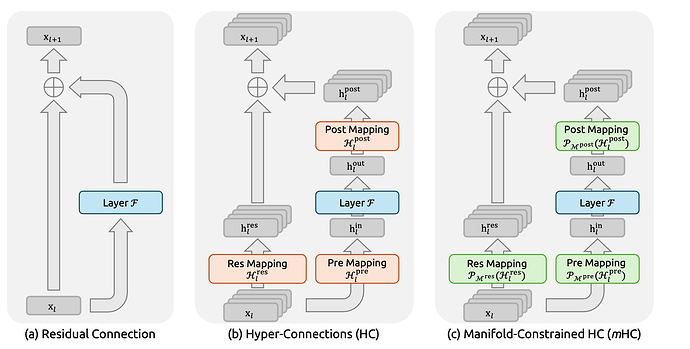

2.1 mHC:基于流形约束的高维旁路连接

mHC(Manifold Hypothesis Constraint Hyper-Connections)细节可参考《谈谈DeepSeek mHC》。名称中的“Manifolds Constraint”略显over-claim,本质更接近双随机矩阵约束的Hyper-Connection(可暂称DS-HC)。DeepSeek可能希望强调这一范式可迁移至其他场景,例如将参数分布视为统计流形上的点,利用测地线距离、曲率或Fisher信息度量进行约束。这在RL后训练的Off-policy加速中可能大有作为(后续会单独成文分析,参考去年文章《大模型时代的数学基础(9):SDPA、最优传输、强化学习与信息几何的联系》)。

mHC基于Sinkhorn-Knopp迭代算法的处理极为巧妙,在LLM领域较为少见(早期Sink Attention及《Scaled-Dot-Product Attention as One-Sided Entropic Optimal Transport》有所涉及)。从Birkhoff多面体性质出发,优雅解决了Hyper-Connection训练稳定性问题。

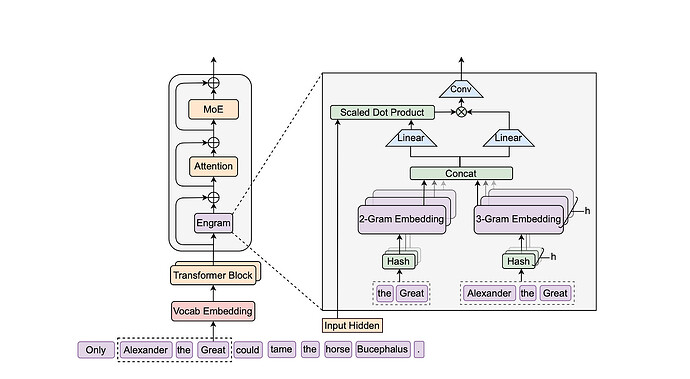

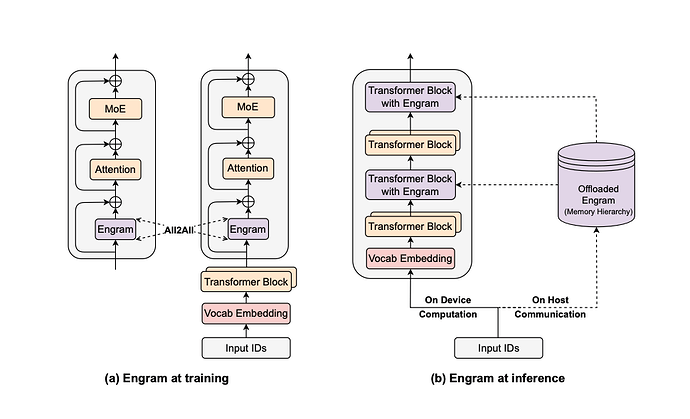

2.2 Engram:条件记忆与动态计算分配

Engram(详见《谈谈DeepSeek Engram: Conditional Memory》)本质上延续了Mixture-of-Depths与Mixture-of-Recursions的思想,解决传统Transformer对所有token均匀分配计算资源的低效问题。早期Recursive Attention虽等效增加深度,但Engram更轻量:对计算需求较低的token通过N-gram嵌入上下文,有选择性地提升复杂token的Attention预算。

Engram的工程亮点包括:

- Multi-head Hash实现O(1)复杂度,可Offload至CPU,对推理极友好;

- N-gram嵌入采用门控机制,巧妙复用Attention原生运算。

当前Engram仍偏静态记忆,未来可能向Google的Test-Time Learning方向演进。

3. 对DeepSeek-V4的整体预测

3.1 Attention结构

基于公开线索,DSA + mHC + Engram的组合几乎是明牌,将成为新一代Attention核心。

3.2 MoE结构

MoE本轮预计变化不大,主要从Engram视角辅助整体Scaling。

3.3 模型参数规模

结合Engram论文,若目标适配8卡H20/H200类中小规模集群,Attention+MoE主体参数可达1.5T左右,激活参数约70B(兼顾推理速度)。Engram部分利用CPU内存,可扩展至1T规模,总参数预计2T~2.5T。

具体推算:

- Hidden size可能进一步提升至12K~16K(DSA使维度扩展的算力代价可控);

- mHC(n=4)预计带来显著性能增益;

- 层数保持60层左右,避免过长序列影响TPOT(Tokens Per Output Token)效率。

此外,我非常希望DeepSeek能同步推出小型号:主干120B左右 + Engram 100B左右,总规模200B~300B。这对国产卡、合规海外卡以及单机/小集群部署极为友好,也足以支撑大多数ToC场景的高并发Serving。

3.4 RL后训练方向

过去一年DeepSeek在RL领域公开成果较少,主要有GRM(自生成多维度原则打分,提升泛化)与R3(Rollout Routing Replay,训推对齐)。我特别期待他们将Manifolds Constraint思路迁移至RL,构建高质量Off-policy数据,突破当前On-policy为主的稳定性和速度瓶颈(据传当前迭代周期仍在几百至几千秒)。这将是一条极具前景的路径。

整体而言,DeepSeek-V4若按上述方向落地,将在参数效率、长上下文处理与推理成本上实现新的突破,值得高度期待。