2026 年 4 月 16 日,一直低调深耕底层架构的 DeepSeek,突然在 GitHub 对其核心算子库 DeepGEMM 发布了一次重磅公开更新。这是 DeepGEMM 开源以来规模最大、技术最激进的一次升级,直接抛出 Mega MoE、FP4 Indexer 两大杀器,同时带来全套混合精度 GEMM 优化,瞬间引爆业内对其下一代基座架构的猜想。

尽管官方在 PR 中明确声明:

“本次更新仅与 DeepGEMM 有关,与内部模型发布无关。Mega MoE 仍在开发优化中。”

但业内普遍认为,这组底层能力极有可能是为 DeepSeek V4 提前铺路的基础设施级革命。

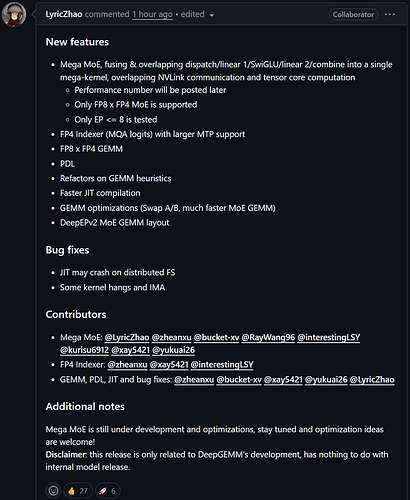

一、本次更新到底更了什么?(核心清单)

本次 PR #304 新增与优化内容非常密集:

-

Mega MoE 融合超大核:将分发、两层线性、激活、合并全部 fuse 一体

-

FP4 Indexer (MQA logits):支持更大 MTP 尺寸

-

FP8 × FP4 GEMM 混合精度矩阵乘

-

PDL 调度优化,降低 kernel 启动延迟

-

更快 JIT 编译速度

-

GEMM 启发式策略重构

-

MoE GEMM 大幅加速(Swap A/B 等)

-

适配 DeepEPv2 MoE 数据布局

-

修复分布式 FS 下 JIT 崩溃、kernel 挂死、内存越界等问题

这不是小修小补,而是把 MoE 推理 / 训练的整条流水线重写了一遍。

二、Mega MoE 到底是什么?(最通俗解读)

MoE(混合专家)是当前超大模型的标配架构,但传统实现效率极低:

-

分发(dispatch)

-

第一层线性(linear 1)

-

SwiGLU 激活

-

第二层线性(linear 2)

-

合并(combine)

传统做法:5 个独立 kernel 串行跑,中间大量显存搬运、NVLink 等待、GPU 空转。

结果就是:模型越大,GPU 利用率越低,速度上不去。

Mega MoE 的革命性突破

把五步全部熔成一个 mega-kernel,一次性跑完。

并且做到:

-

NVLink 通信与 Tensor Core 计算完全重叠

-

不再 “算完再传、传完再算”

-

数据搬运几乎全部消除

-

GPU 保持持续满负荷

相当于把 “接力搬砖” 改成 “高速一体化传送带”,延迟大幅降低、吞吐量暴增。

关键约束(业内高度关注)

-

仅支持 FP8 × FP4 混合精度

-

仅测试 EP ≤ 8 分布式场景

-

依赖对称内存分配

-

需要 PyTorch 2.9+

这组限定条件,几乎指明了 DeepSeek 下一代模型的精度方案、并行策略、卡间通信架构。

三、FP4 Indexer:把显存与算力压到极限

除了 Mega MoE,本次另一项重磅更新是 FP4 Indexer,专门用于 MQA logits 注意力评分。

它的价值:

-

在几乎不损失效果的前提下

-

把 logits 计算压到 FP4

-

支持更大 MTP(最大令牌数)

-

进一步降低显存占用、提升推理速度

配合 FP8 × FP4 GEMM,DeepSeek 正在走出一条极低比特、超高效率的 MoE 技术路线,逼近硬件精度下限。

四、DeepGEMM 从此升级为 “全栈大模型算子库”

经过这次更新,DeepGEMM 已经不再只是一个 FP8 GEMM 库,而是变成统一的高性能 Tensor Core 算子平台,覆盖:

-

GEMM:FP8 / FP4 / BF16

-

通信计算重叠融合 MoE(Mega MoE)

-

MQA 闪电索引(FP4 Indexer)

-

HyperConnection (HC)

-

全流程 JIT 编译,安装免 CUDA 编译

这是一套可以直接支撑下一代万亿 MoE 模型的底层引擎。

五、业内解读:这可能意味着什么?

由于更新信息量极大,海外技术社区迅速出现高热度分析:

-

Mega MoE + DeepEPv2 = 下一代 MoE 训练 / 推理框架完全体

DeepSeek 正在把 MoE 从 “难用、低效” 变成 “工业化、高吞吐、低延迟”。

-

FP8 × FP4 说明:极致追求性价比与规模

能在更低比特下保持能力,意味着同样算力能跑更大模型。

-

代码中出现 tcgen05 指令

指向 NVIDIA 最新 Blackwell 架构(B 系列) 专属算子,

侧面印证 DeepSeek 仍在使用顶级 NV 加速卡。

-

模型规模推测

有开发者根据单层 MoE 参数估算:

-

单层约 25.37B

-

若 60 层 ≈ 1.6T 超大模型

-

若 48 层 ≈ 1.25T 超大模型

无论最终数值如何,都指向超大规模 MoE 基座。

六、官方态度:冷静但充满信号

官方在 PR 中连续强调:

-

Mega MoE 仍在开发优化

-

性能数据稍后发布

-

欢迎社区提供优化思路

-

本次更新不等于模型发布

这种 “放技术、藏产品” 的操作,是典型的底层先行、架构预热。

七、总结:一次决定未来格局的底层升级

DeepSeek 这波悄悄更新,表面是算子库升级,实质是:

把 MoE 架构的工程效率推到新高度,为下一代超大模型铺平道路。

-

Mega MoE:一体化核,通信计算重叠

-

FP4 Indexer:极致省显存、提速度

-

FP8 × FP4:行业最激进的混合精度路线

-

DeepEPv2 适配:全新分布式并行体系

对于关注大模型底层技术的人来说,这是 2026 年至今最重要的基础设施更新之一。

至于它是不是 DeepSeek V4 的 “官方剧透”,我们只需拭目以待。