在 AI 圈被调侃 “永远在路上” 的DeepSeek V4,终于迎来官方定档。

DeepSeek 创始人梁文锋在内部沟通中明确:新一代旗舰大模型 DeepSeek V4,将于 2026 年 4 月下旬正式发布,并以 Apache 2.0 协议开源。消息已被多位知情人士确认,成为近一个多月来,来自 DeepSeek 内部最确定的一次发布信号。

从年初传闻不断、多次延期,到 3 月全线宕机、团队人事震荡,再到如今官宣档期、全面切换国产算力,DeepSeek 这半年堪称 “极限渡劫”。而 V4 的到来,不仅是一次版本迭代,更是一次架构换血、算力换道、团队重构后的全面复出。

一、跳票三次:从春节等到清明,V4 到底在憋什么?

DeepSeek V4 的爆料从今年 1 月就没停过:

-

1 月 9 日,The Information 爆料:V4 春节前后发布,主打编程能力;

-

2 月 25 日,路透社跟进:V4 已向华为开放适配,英伟达被排除在外;

-

但春节、清明接连过去,模型始终未露面。

“永远在上线的 DeepSeek” 一度成为圈内名梗。

而真实原因并非 “跳票”,而是底层算力在彻底大换血:

过去几个月,DeepSeek 与华为、寒武纪深度合作,把整套依赖英伟达 CUDA 的底层代码,全部重写到华为 CANN 框架上。

更关键的是:

DeepSeek主动拒绝了英伟达、AMD 的 V4 早期适配权限,只把窗口期留给国产芯片。

业内普遍判断:模型其实早已训练完成,但全栈国产化适配,拖慢了发布节奏。

二、连崩三天的 “故障”:实为 V4 灰度上线

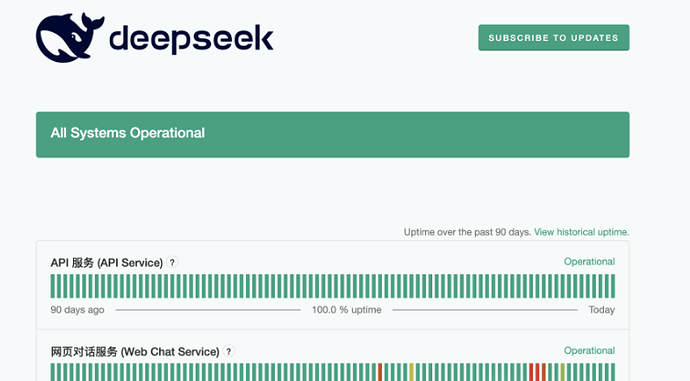

3 月 29 日 —31 日,DeepSeek 出现史诗级波动:

-

服务连续三天宕机,最长一次中断超过13 小时;

-

恢复后,大量开发者反馈:模型明显 “变了”:

-

代码结构更清晰

-

SVG 生成能力明显增强

-

思维链不再冗长废话

-

逻辑严谨度显著提升

-

官方当时只轻描淡写 “服务器故障”,但行业几乎一致认定:

这是 V4 在灰度上线、全量压测。

紧接着,4 月 8 日,DeepSeek 在网页端悄悄上线:

-

快速模式:日常对话、即时响应

-

专家模式:复杂推理、已支持文件上传与多模态

这是 DeepSeek 走红以来,第一次在产品端做模式分层,也被视作 V4 的 “前菜”。

但目前能摸到的版本,128K 就触达 Token 上限,和传闻中百万上下文相去甚远,更像是 V4 Lite 的预热版本。

三、团队震荡:半年 4 位核心出走,V4 关键人物离职

过去半年,DeepSeek 团队经历明显动荡,已有 4 名核心成员离开:

-

王炳宣:V1 时代 LLM 核心作者,被腾讯挖走;

-

魏浩然:OCR 系列核心开发者;

-

阮翀:多模态关键贡献者,今年 1 月加入自动驾驶公司元戎启行;

-

郭达雅:R1 核心作者、GRPO 方法关键发明人,近期正式离职,去向未公布。

其中郭达雅最受关注:

-

95 后,中山大学博士;

-

2023 年加入 DeepSeek,几乎参与所有关键模型:Coder、Math、V2、V3、R1;

-

业界广泛使用的GRPO 强化学习方法,就出自他参与的 DeepSeekMath 论文。

有业内爆料称:

“外面开出的总包翻 2-3 倍,有公司直接开出八位数。”

但即便人员波动,DeepSeek 整体依然稳定运转。

原因在于梁文锋的管理风格:

-

研究团队只有两层:梁文锋 + 研究员,极度扁平;

-

不打卡、无强 KPI,多数人晚上六七点就下班;

-

理念:人每天高效输出只有6-8 小时,加班只会带来昏庸决策、浪费算力。

这种 “不卷” 文化,让团队扛住了核心流失的冲击。

四、DeepSeek V4 全貌曝光:万亿 MoE、百万上下文、双技术黑科技

尽管官方未放详细参数,但 V4 的轮廓已经非常清晰:

1)模型与版本

-

架构:万亿参数 MoE 混合专家

-

推理激活:约370 亿参数(和 V3 量级相当,成本可控)

-

三版本路线:

-

V4 Lite:对应快速模式

-

V4:旗舰版,对应专家模式

-

V4 Vision:原生多模态(前端代码已预留入口)

-

2)上下文与记忆

-

上下文窗口:100 万 tokens

-

两大杀手锏技术来自年初两篇论文:

-

mHC(流形约束超连接):梁文锋亲自署名,解决万亿模型训练崩溃问题;

-

Engram(条件记忆):与北大合作,把模型 “字典” 从昂贵 HBM 显存,搬到廉价 CPU 内存,用时查表。

-

效果极其夸张:

-

Engram-27B 大海捞针准确率从84.2% → 97%;

-

千亿参数嵌入表放到 DRAM,吞吐量只跌不到 3%;

意味着:V4 不仅不吃更多显存,还能用便宜几倍的内存顶上去。

3)性能与成本

-

推理速度对比 V3 提升35 倍;

-

能耗降低40%;

-

推理成本约为 GPT-4 的1/70;

-

可在消费级显卡上实现万亿模型本地部署。

4)开源协议

- 采用Apache 2.0开源,企业可放心商用、二次发布、闭源修改,自由度极高。

五、彻底抛弃英伟达:全球首个万亿模型全栈国产化

V4 最震撼的行业意义,是算力独立。

-

训练 + 推理100% 跑在华为昇腾 950PR;

-

底层框架从CUDA → 华为 CANN;

-

算子重写、调度重构、内存模型完全适配国产芯片;

-

拒绝英伟达、AMD 早期适配,只对国内芯片开放。

这是全球首个:

-

万亿参数级别

-

全链路脱离英伟达

-

完全基于国产芯片 + 国产框架

的顶级大模型。

意义早已超出一家公司、一个版本:

中国 AI 正式打破高端算力封锁,实现 “模型 + 芯片 + 框架” 全栈自主。

六、深求社区观点:V4 是 “国产模型成人礼”

从 R1 发布至今,DeepSeek 已经近 15 个月没有大版本更新。

这 15 个月里:

-

跳票 3 次

-

换了整套算力底座

-

走了 4 位核心

-

崩过一次全站服务

-

重构了一遍底层代码

但全世界都还在等。

因为 DeepSeek V4 不只是一款模型:

-

它是开源社区的期待:Apache 2.0 万亿模型,会彻底重构生态;

-

它是算力自主的标杆:证明中国可以不靠 NV,做出世界顶阶大模型;

-

它是产品路线的拐点:从 “比参数” 进入 “比体系、比成本、比落地”。

4 月下旬,不止是一次发布,

更像一场迟到半年的国产 AI 成人礼。