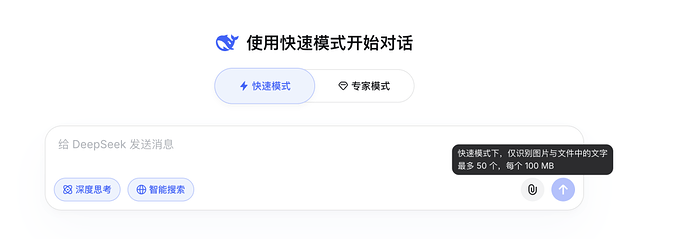

DeepSeek 网页端悄悄上线了大更新——没有发布会,没有 blog,甚至没有一条官方推文。输入框上方多了两个图标:一个闪电![]() ,一个钻石

,一个钻石![]() ,分别对应「快速模式」和「专家模式」。

,分别对应「快速模式」和「专家模式」。

两种模式的区别

| 维度 | 快速模式 |

专家模式 |

|---|---|---|

| 定位 | 适合日常对话,即时响应 | 擅长复杂问题,高峰需等待 |

| 背后模型 | 大概率是 V4 Lite 轻量版 | 疑似路由到更大更强的模型 |

| 多模态 | ||

| 速度 | 快 | 较慢,高峰期需排队 |

一个反直觉的点:更强的模型反而功能更少?这说明专家模式可能还在灰度阶段,功能尚未完全打开。

实测对比

物理仿真:p5.js 弹跳球

让两个模式各写一个 p5.js 程序,模拟球在旋转六边形内弹跳(受重力和摩擦力影响):

结果:专家模式给出的结果更符合物理直觉,落点更准,弹跳轨迹更真实。快速模式肉眼可见差了一个档次。

物理仿真对数学推理能力要求高,弱一点的模型容易出现「看起来像物理但实际上不对」的结果。

游戏开发:太空侵略者

但网友 @AiBattle_ 的太空侵略者游戏测试中,专家模式和快速模式差距并不明显。

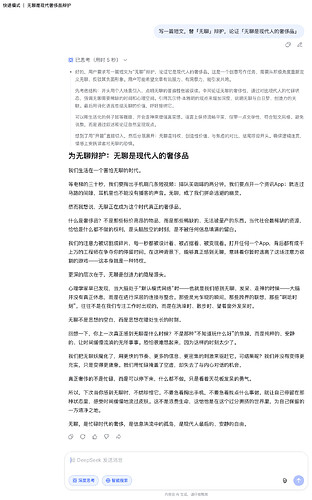

创意写作:「替无聊辩护」

辩论题:「论证无聊是现代人的奢侈品」。专家模式输出更长、逻辑链更完整;快速模式文风相对自然朴实。有意思的是,在创意写作任务上两者速度差距不大——创意写作对模型规模的敏感度远低于数学推理。

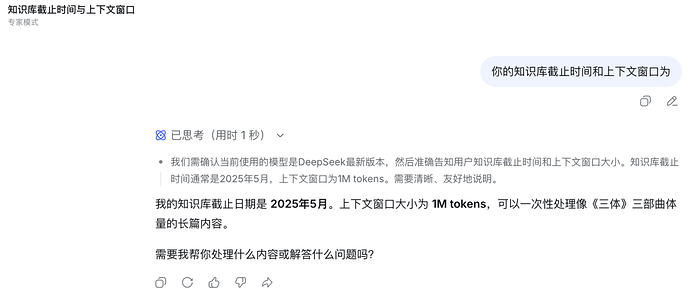

数学逻辑:绳子绕地球

「绳子绕地球一圈,加长 1 米均匀撑开,缝隙多高?」两个模式答案相同,但专家模式一步步拆解推导,快速模式则很简略。

小结

简单任务,两个模式差异有限;越是需要深度推理的场景,专家模式优势越明显。

Vision 模式:第三个选项正在路上?

此前爆料显示,还有第三个选项「Vision 模式」正在准备中。

关注 DeepSeek 技术路线的博主 Teortaxes 认为:把 Vision 单独列为一个模式很不寻常。DeepSeek 此前拒绝在网页端部署 DS-VL 系列,原因是「尚未成熟」。如果 Vision 模式真的上线,背后可能已经是一个完全功能化的 VLM,甚至可能是 Janus 系列的下一步演化。

不过也有网友指出,前端代码逆向显示 Vision 模式并没有独立模型,只是在快速模式下加了一个 filefeature.vision = true 参数。

更深层的信号:产品分层

这次更新背后有一个更值得关注的方向:DeepSeek 开始做产品分层了。

自去年爆火以来,DeepSeek 一直高度「反商业」——API 定价极低,网页端完全免费,功能无门槛区分。但「全免费、无分层」的运营方式长期不可持续。

现在,DeepSeek 把「更强的模型」和「更基础的模型」做成两个入口,这个架构一旦搭好,后续做付费体系在技术上已不是问题。

当然分层未必只为收费——把请求分流到不同模型本身就是算力调度策略,缓解峰值压力。

整件事拼起来看,是一个完整的铺垫路径:

灰度分层入口 → 让用户感知差异 → 打通多模态 → Vision 模式开闸 → 限额/定价

晚点 LatePost 报道,V4 正式版预计今年 4 月亮相,大概率仍是开源最强,但「很难是碾压级的强」。

DeepSeek 搅动了整个 AI 圈,但现实也终将搅动 DeepSeek。