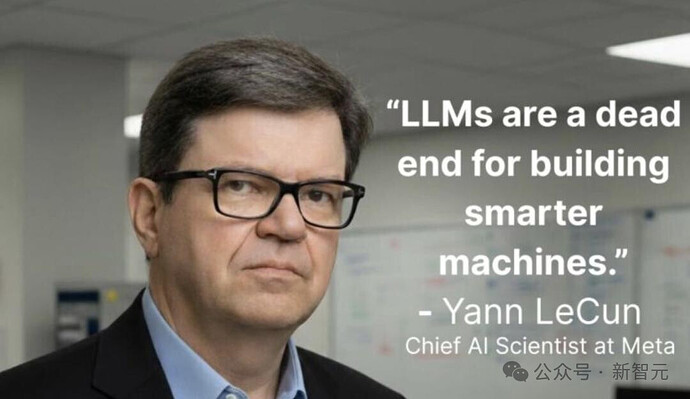

OpenClaw 能写代码、改方案、查资料,堪称数字世界的多面手,却连炒一盘蛋炒饭都做不到 —— 这背后暴露了 AI 的核心短板:懂语言,却不懂物理世界。当图灵奖得主 LeCun、「AI 教母」李飞飞各自拿下 10 亿美元融资,押注世界模型与空间智能,一个更底层的问题浮出水面:谁来为 Physical AI(物理智能)提供真正能用的数据?

Ropedia 给出了颠覆性答案:不是更多零散视频,而是一部结构化的「人类经验百科全书」。其最新发布的 Xperience-10M 数据集,包含 1000 万条人类交互经验、超 10000 小时真实场景数据,以 4D 多模态结构,为机器人理解物理世界、学会动手做事,提供了可直接训练的「教科书级」数据底座。

一、从语言智能到物理智能:缺的是「可行动的经验数据」

过去十年,AI 的飞跃依赖互联网规模的文本、图像和视频,大模型学会了「看懂」和「表达」,却始终无法「行动」。机器人要在物理世界完成任务,不仅要识别物体,更要理解:如何移动、如何操作、动作会带来什么后果 —— 这些「感知 - 意图 - 动作 - 交互 - 后果」的完整经验链条,正是现有数据的致命缺口。

互联网上的海量视频多是「被动观看素材」,缺少深度信息、空间结构、手部轨迹和因果关联。对 Physical AI 而言,一千小时的 YouTube 视频,远不如一小时结构化的人类真实交互经验有用。英伟达 EgoScale 研究更用硬数据证明:第一视角人类数据规模每扩大一倍,机器人策略性能就稳定提升,大规模人类经验数据,是机器人灵巧操作的核心监督来源。

LeCun 创办的 AMI Labs 拿下 10.3 亿美元种子轮,李飞飞的 World Labs 估值飙至 50 亿美元,两大巨头不约而同押注物理世界智能,这标志着:AI 行业的竞争焦点,已从语言智能转向物理智能,而高质量经验数据,正是打通这一鸿沟的关键桥梁。

二、Xperience-10M:1000 万条经验,一部 4D「人类行动百科」

Ropedia 发布的 Xperience-10M 数据集,早已在 Hugging Face 开源,它不是简单的视频合集,而是为机器量身打造的「经验百科全书」—— 涵盖 350K 个物体、720M 帧深度图像、576M 帧动作捕捉数据,总存储量达 PB 级,将人类在真实世界的行动,转化为机器可理解的结构化知识。

核心亮点:4D 物理世界框架

Ropedia 定义的 4D,不止是「3D + 时间」,而是「3D + 时间 + 交互 + 后果」的完整闭环,覆盖机器理解物理世界的四大核心维度:

-

空间(Where):环境结构、物体位置与拓扑关系;

-

行动(How):全身动作、手部灵巧操作的精准轨迹;

-

交互(With What):人与物体、场景、任务的作用关系;

-

后果(What Changes):动作引发的真实物理状态变化。

只有同时掌握这四大维度,机器人才能明白「做什么、怎么做、会怎样」,比如炒蛋炒饭时,知道如何开火、倒油、翻炒,理解火候大小对蛋液的影响,而不是机械重复动作。

五大核心数据维度,全链路对齐

数据集在同一时间轴和结构框架下,同步提供五大维度信息,彻底解决数据碎片化问题:

-

视觉流信息:360° 第一视角 RGB 采集,还原真实观察场景;

-

空间信息:高精度深度数据、环境拓扑结构,让机器感知距离与形态;

-

动作信息:全身运动捕捉、手部精细操作轨迹,复刻人类行动细节;

-

交互信息:标注人与物、人与场景的作用关系,明确行动对象与方式;

-

语义信息:任务描述、原子动作、行为意图,让机器理解行动目的。

这种多维度天然对齐的特性,让数据可重放、可建模、可学习,直接喂入模型即可训练,无需额外处理。

三、HOMIE 采集系统:把数据采集做成「戴眼镜般自然」

高质量数据的核心难题,在于「如何在真实场景中规模化采集」。特斯拉 Optimus 需要人员穿戴重型动捕服在专用设施采集,Figure 依赖 Vision Pro 遥操作,这些方案成本高、场景受限,无法覆盖真实世界的千变万化。

Ropedia 早在 2025 年就推出端到端采集平台 HOMIE,彻底打破这一限制:

-

轻量化无感化:无需重型设备和第三人称相机,用户佩戴轻量化头戴设备,即可在日常生活场景中自然采集,不影响正常行动;

-

全场景适配:数据采集可发生在厨房、办公桌、工厂产线等任意场景,真正覆盖真实世界的长尾需求;

-

高稳定性保障:支持长时间佩戴,具备自运动追踪、多传感器精准同步能力,确保数据质量一致。

HOMIE 更像「物理世界百科全书」的入口,让高质量数据闭环从实验室走向千家万户,为数据集提供源源不断的真实素材。

四、核心竞争力:数据飞轮驱动的结构化标注

原始经验不等于智能数据,Ropedia 的真正壁垒,是其背后的空间基础模型与自动标注体系,形成类似特斯拉 FSD 的数据飞轮效应:

-

自动标注能力:通过空间基础模型,自动完成空间定位、手 - 物交互追踪、全身动作捕捉、场景语义理解等结构化标注,无需人工干预;

-

飞轮迭代:采集数据一方面交付客户,另一方面回灌优化模型,模型越强,标注质量越高,反之亦然,迭代速度远超人力标注;

-

高质量输出:最终交付的不是原始素材,而是标准化、结构化的智能数据,可直接接入模型训练管线。

这种「采集 - 标注 - 优化」的闭环,让 Ropedia 的数据质量持续提升,也使其区别于单纯拼体量的无结构数据集。

五、行业范式转移:机器人数据采集的三次进化

Ropedia 的「经验百科」模式,标志着机器人数据采集进入第三阶段,完成了从「虚拟到真实」「专业到泛化」的关键跨越:

-

第一阶段:仿真数据主导。成本低、可复制,但存在严重的「仿真 - 真实鸿沟」,策略落地即退化;

-

第二阶段:遥操作数据兴起。动作来自真实机器人,但依赖受控环境,成本高、无法规模化覆盖长尾场景;

-

第三阶段:以人为中心的经验数据。让人类在真实场景自然行动,通过轻量化设备采集,用规模和多样性突破泛化瓶颈,这与自动驾驶从「专业车队采集」到「量产车影子模式」的进化逻辑一脉相承。

英伟达 EgoScale 研究已验证这一路径的有效性:20000 + 小时第一视角人类数据训练的模型,平均成功率比无预训练基线提升 54%,以人为中心的经验数据,已成为机器人基础模型泛化的主路径。

六、不做模型不造机器人,只做 Physical AI 的「高辛烷值燃料」

Ropedia 的定位极具独特性:它既不做世界模型,也不造人形机器人,而是专注于数据科学,成为 Physical AI 赛道的「基础设施供应商」。

其商业模式已清晰落地:以新加坡为全球化运营枢纽,聚焦北美核心市场,形成「采集设备 + 数据服务 + 标准化交付」的综合模式,客户覆盖北美十多家头部具身智能、空间智能公司及研究团队36氪。这些客户选择 Ropedia,核心不是缺视频,而是缺能直接训练的高质量结构化经验数据。

这让人联想到大语言模型时代的 Scale AI 与 Surge AI—— 后者以对数据质量的极致追求,用小团队实现营收反超。Ropedia 正沿用这一逻辑,在 Physical AI 赛道深耕:Physical AI 的数据复杂度呈指数级上升,「能转化多少高质量结构化数据」,远比「拍了多少视频」更有价值。

结语:物理智能时代,经验是新的基础设施

过去,互联网沉淀了「人类说了什么、写了什么」,塑造了语言智能;未来,Physical AI 需要沉淀「人类如何行动、如何改变世界」,而这正是 Ropedia 正在构建的核心价值。

Xperience-10M 数据集的开源,只是一个开始。当机器人走进千家万户,需要学习不同家庭的洗碗机用法、生活习惯时,持续的人类经验采集与结构化,将成为不可或缺的服务。Ropedia 的「经验百科全书」,不仅为当下的 Physical AI 提供了训练燃料,更在定义未来物理智能的基础设施标准。

当机器第一次系统性地学习人类的行动经验,Physical AI 的真正时代才会拉开帷幕 —— 而 Ropedia,正站在这一变革的起点。

如需体验 Xperience-10M 数据集,可通过以下链接获取:

- Hugging Face 开源地址:https://huggingface.co/datasets/ropedia-ai/xperience-10m