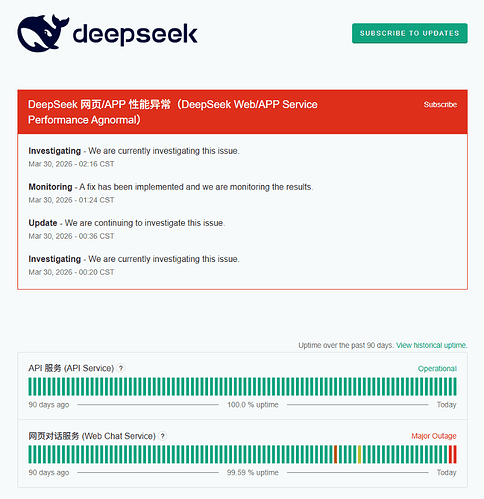

前阵子 DeepSeek 宕机 12 小时,引发网友一片哀嚎 ——“生活已经不能没有 AI 了” 这句话,如今早已从抱怨变成了无数人的日常陈述。写作业、理思路、选餐厅,甚至纠结要不要道歉,都习惯先问 AI。我们默认 AI 就该顺滑、即时、永远在线,但这种 “理所当然” 的背后,是否藏着被忽视的危机?

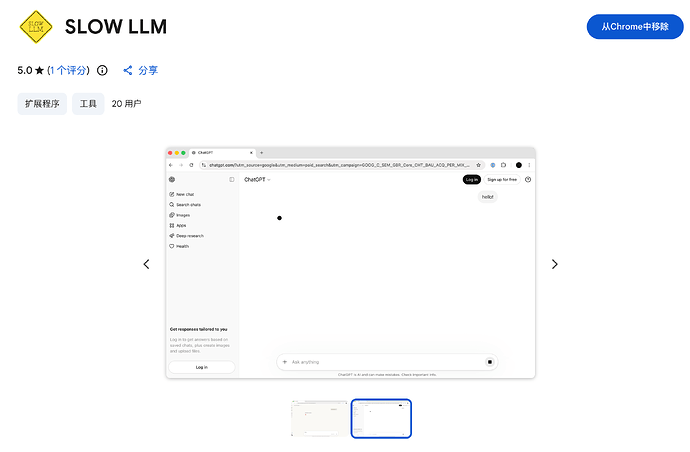

德克萨斯大学奥斯汀分校设计系助理教授 Sam Lavigne,用一款看似 “缺德” 的插件给出了反思:名为Slow LLM的浏览器扩展程序,专门让 ChatGPT、Claude 等 AI 的响应速度变得极其缓慢,用刻意制造的卡顿,逼着人们重新思考:我们是否正在把思考和情感,一并外包给 AI?

反向操作:AI 没崩,是插件在 “掐着水管”

Slow LLM 的核心功能简单又极端:不影响 AI 的正常推理和服务器运行,只在数据传输环节动手脚,让原本秒出的回复变成 “一字一顿” 的煎熬。其原理并不复杂,却精准击中了 AI 交互的关键环节:

浏览器与 AI 服务器之间的数据传输,依赖 JavaScript 的 Fetch 函数。Slow LLM 会在用户访问 AI 聊天网站时,悄悄替换这个函数,换成一个故意延迟数据释放的版本 —— 就像 “掐着水管” 放水,AI 的回答早已到达本地,却被人为拉长展示时间,营造出 AI “思考卡顿” 的错觉。

这款工具提供两种便捷部署方式,覆盖不同使用场景:

-

Chrome 浏览器插件:仅影响单设备,安装后随时可关闭,实测中 ChatGPT 的文字会逐字蹦出,堪比早年拨号上网的加载体验;

-

DNS “企业版”:修改路由器 DNS 地址后,整个网络下的所有设备都会受影响,除了 ChatGPT 和 Claude,还能拖慢 Grok、Gemini 等其他 AI 工具。

目前,Slow LLM 的代码已在 GitHub 完全开源,有技术基础的用户还能自建 DNS 服务器,实现更灵活的部署。Sam Lavigne 甚至透露,考虑在 “毫不知情的人” 身上测试,看看他们是否会因愤怒而退出 LLM。

不是恶作剧:用 “摩擦” 对抗 AI 引发的 “去技能化”

如果你以为这只是一场技术恶作剧,就低估了 Sam Lavigne 的深意。长期以来,他的研究和创作都围绕 “计算系统如何重塑人类行为” 展开,Slow LLM 是他发起的又一次 “数字破坏实验”—— 用刻意制造的 “摩擦”,对抗硅谷奉为圭臬的 “无摩擦体验”。

在互联网产品逻辑里,“摩擦” 是原罪:多余的跳转、支付密码、哪怕两秒的延迟,都被视为影响转化的障碍。过去十几年,产品经理的核心工作就是消除一切阻力,而 LLM 则把这种逻辑推到了极端:任何让人感到费力的认知劳动,都能通过 AI 外包。写邮件、整理思路、做简单决策,甚至梳理情绪,AI 都能代劳。

但 Sam Lavigne 发现了一个危险的趋势:人们越依赖 AI 处理这些 “小事”,就越容易丧失对应的能力,陷入 “去技能化” 的陷阱。他在官方宣传语中直接抛出担忧:“你是否担心自己或身边的人,正在参与一场技能大退化?正在遭受 LLM 诱发的认知扭曲?”

在他看来,人类的成长恰恰源于 “困难”:学钢琴的价值在于练习的艰辛,数学题的深刻印象来自解题时的挣扎,一封措辞纠结的邮件,本身就是理清思路、换位思考的训练。而 AI 的无缝代劳,恰恰跳过了这些关键的思考过程。Slow LLM 的初衷,就是把 “阻力” 还回去 —— 让用户在漫长的等待中,有机会问自己一句:“这件事,我能不能自己来?”

自我矛盾的诚实:批评 AI 依赖,却也曾依赖 AI

有趣的是,Sam Lavigne 本人也没能摆脱 AI 依赖。开发 Slow LLM 时,他先用 Claude 写了部分代码,直到部署插件后,AI 响应变得极其缓慢,才被迫靠自己完成剩余工作。这种 “一边批判,一边依赖” 的处境,恰恰戳中了大多数人的现状:

就像有人刷完短视频吐槽 “短视频上瘾”,边点外卖边转发 “外卖毁了厨艺”,我们很难从一个完全外部的位置,批判已经渗透进日常的技术。而 Sam Lavigne 的诚实之处在于,他没有扮演 “清醒的局外人”,而是坦然承认了这种依赖 —— 他用自己的经历证明,Slow LLM 的价值不是 “彻底禁用 AI”,而是 “在使用前多等一等、想一想”。

这早已不是他第一次挑战 “理所当然” 的技术规则。2021 年远程办公热潮时,他开发的 “Zoom Escaper” 能制造婴儿哭声、电钻声等干扰,帮人 “名正言顺” 逃离冗长会议;他还曾与搭档推出 “Slop Avoider” 插件,屏蔽 ChatGPT 发布后的所有搜索结果,躲避 AI 生成的垃圾内容。这些工具看似 “反向操作”,核心都是在提醒人们:不要被技术裹挟,要掌握使用技术的主动权。

比 “变慢” 更值得深思:AI 正在替代思考本身

Slow LLM 引发的争议,本质上是一场关于 “AI 与人类思考关系” 的辩论。历史上,计算器、GPS、搜索引擎的出现,都曾引发 “人类变笨” 的担忧,但最终证明,这些工具只是作为 “被动延伸”,帮人类解放脑力处理更复杂的问题 —— 它们遵循 “扩展心智理论”,始终由人类定义问题、主导思考。

但大语言模型的逻辑完全不同。它是 “主动的”:不仅给出答案,还会提供一套完整的解题路径;在你真正开始思考前,就已经完成了筛选、归纳、重构,把打磨好的结论推到你面前。这种模式下,人类的独立推理环节被直接跳过。2025 年一项覆盖 600 余人的研究显示,高频 AI 使用者的批判性思维能力显著下滑,且呈现 “用得越多、越依赖、越难独立” 的自我强化态势,年轻群体尤为突出。

更隐蔽的是,这种能力侵蚀没有明确的节点。你不会突然意识到 “我不会思考了”,但不知不觉中,遇到问题的第一反应会从 “让我想想” 变成 “问一下 AI”。Slow LLM 或许改变不了什么,但它像一颗硌脚的石子,用刻意的卡顿把问题摆到台面:当我们把思考 “外包” 给 AI 时,是否正在温水煮青蛙般,丢掉人类最宝贵的独立思考能力?

当然,现实是 AI 实在太好用了,好用到质疑它都显得 “矫情”。那些隐隐的不安,往往会被下一个满意的 AI 输出淹没。但 Sam Lavigne 的尝试至少提供了一种可能:在 AI 无缝融入生活的今天,我们或许需要一款 “Slow LLM”,不是为了禁用技术,而是为了给自己留一点思考的时间 —— 毕竟,真正珍贵的不是 AI 给出的答案,而是我们思考的过程。

如果你也想体验这种 “刻意的慢”,可通过以下链接获取工具:

-

GitHub 仓库:https://github.com/antiboredom/slow-llm